Investigacion Owli-AI

Ultrasonic Waves to Support Human Echolocation

HCII (2018) - Paper

Florian von Zabiensky; Michael Kreutzer; Diethelm Bienhaus

Technische Hochschule Mittelhessen, University of Applied Sciences, Giessen, Germany

Aviso: esta pagina fue traducida automaticamente y esta pendiente de revision editorial.

Visual

Resumen

El articulo presenta AHRUS, un sistema que utiliza ultrasonido parametrico para hacer audible informacion del entorno a personas con discapacidad visual o ceguera. Gracias a la autodemodulacion se conservan propiedades direccionales del ultrasonido, de modo que las senales pueden percibirse con los propios oidos. El trabajo describe la arquitectura tecnica de un prototipo y primeros escenarios de uso. En una evaluacion inicial con cuatro participantes, el sistema se probo en la practica. En comparacion con la ecolocalizacion flash sonar clasica, el enfoque muestra ventajas en estructuras pequenas y en el problema stealth de superficies lisas.

Palabras clave

- Human Echo Localization

- Audible Ultrasound Sonar

- Blind People

- Spatial Hearing

- Obstacle Detection

Descarga

Figuras

13 visuales del paper.

-

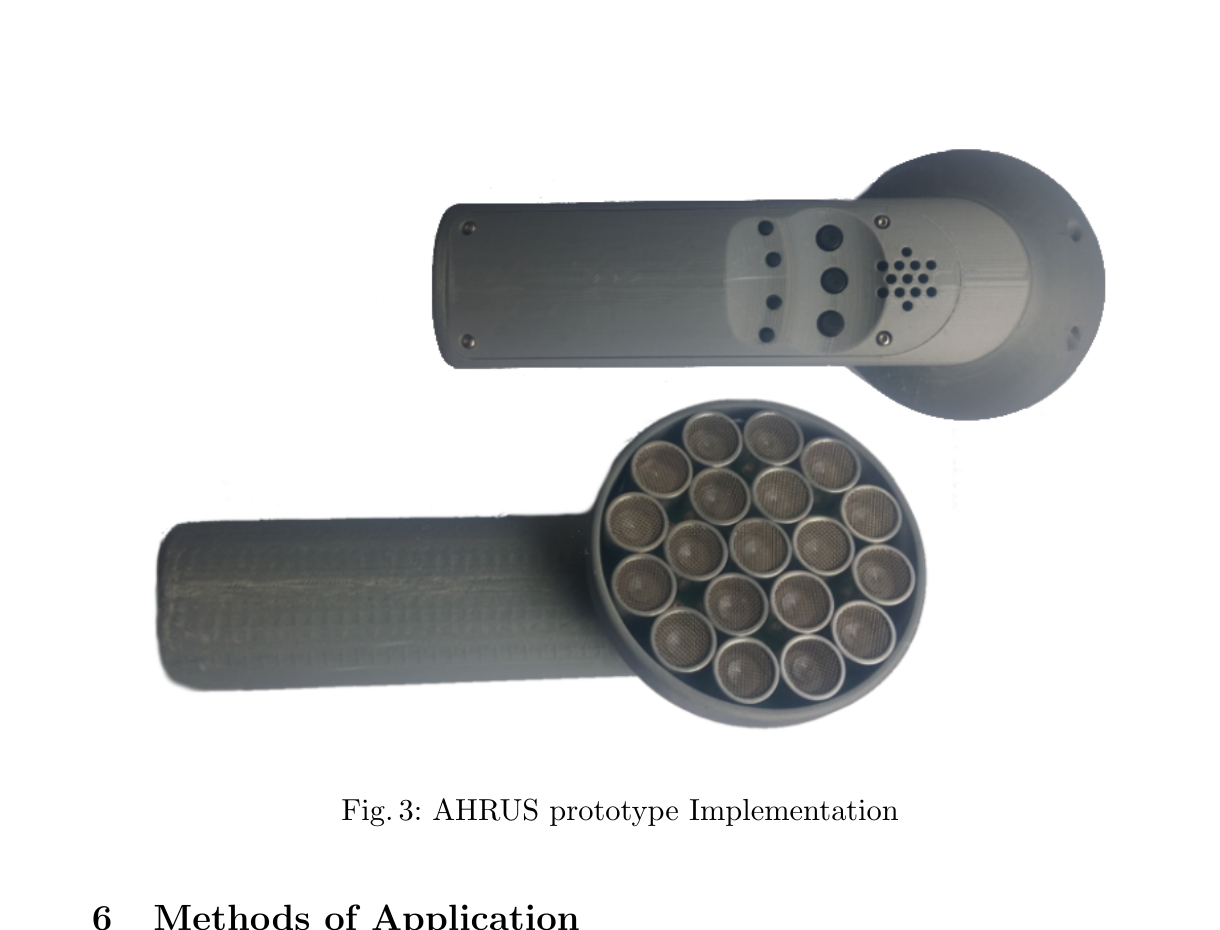

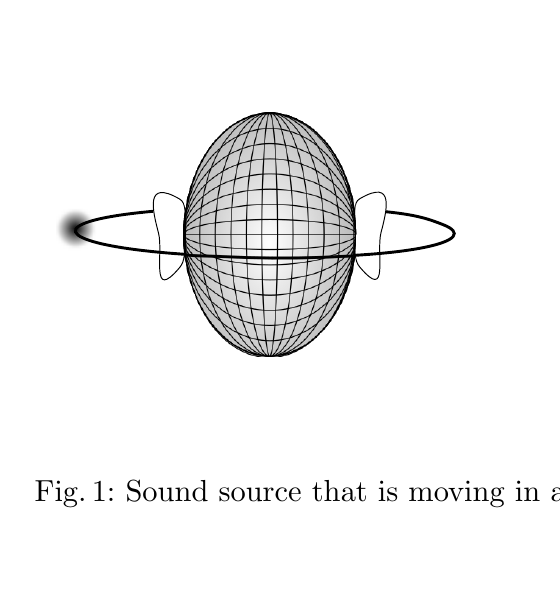

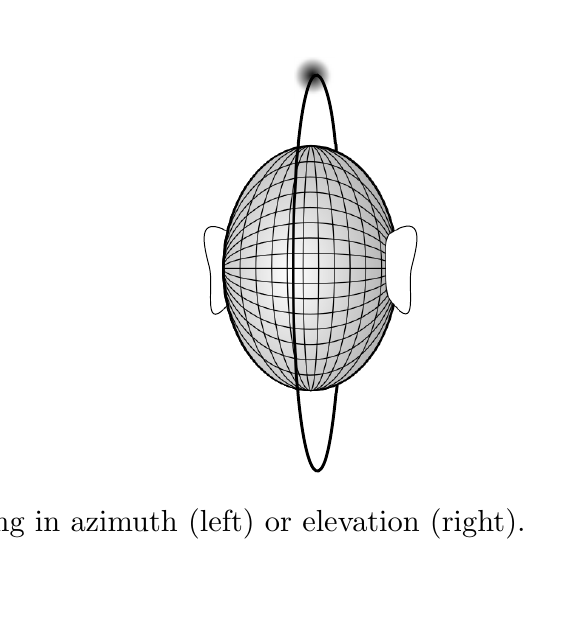

Fig. 1 Vista general de representacion direccional. -

Fig. 1 Detalle izquierdo (acimut). -

Fig. 1 Detalle derecho (elevacion). -

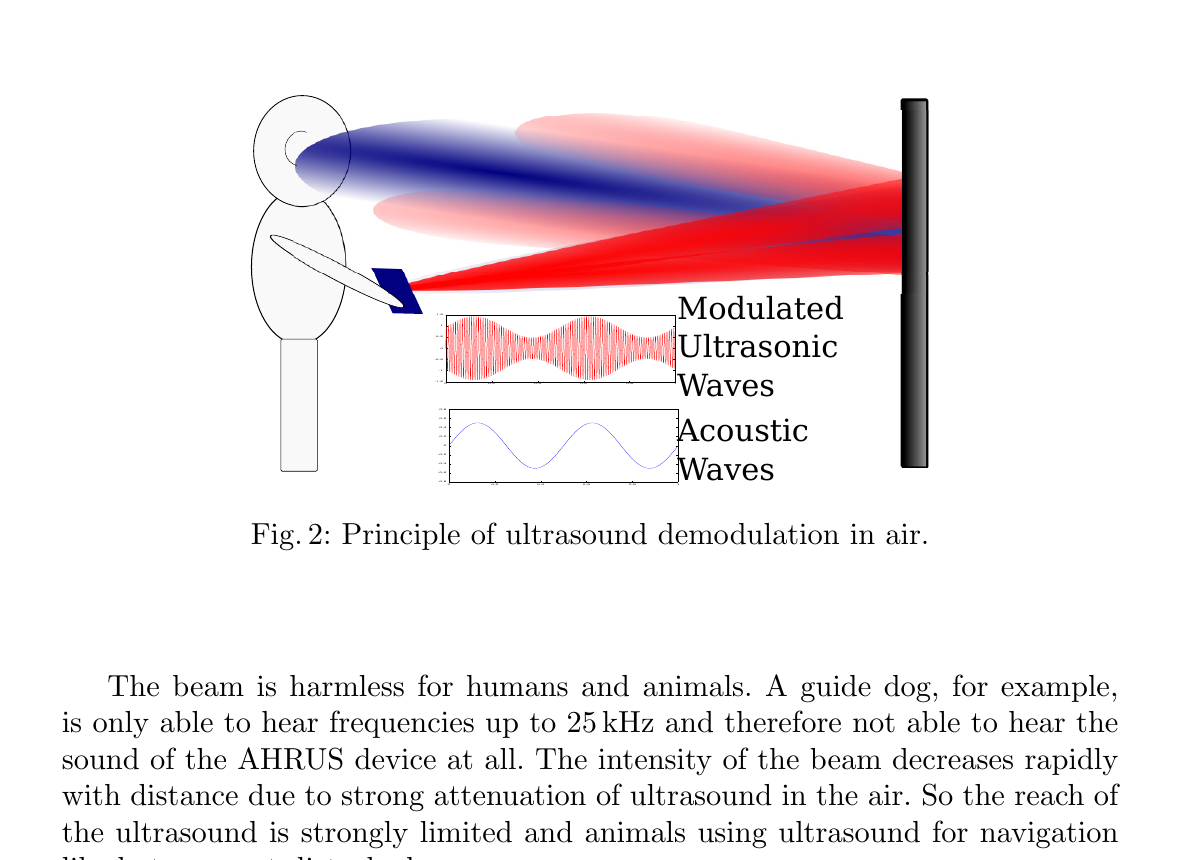

Fig. 2 Principio de demodulacion por ultrasonido. -

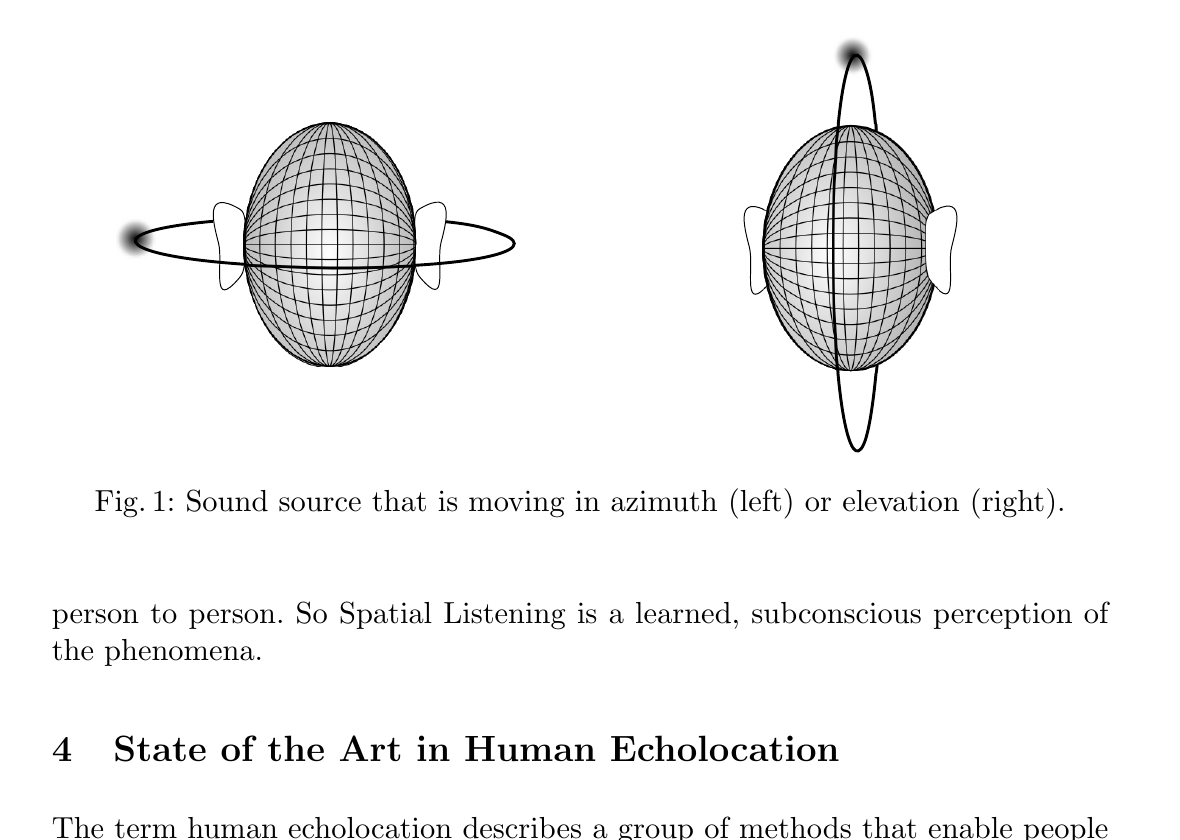

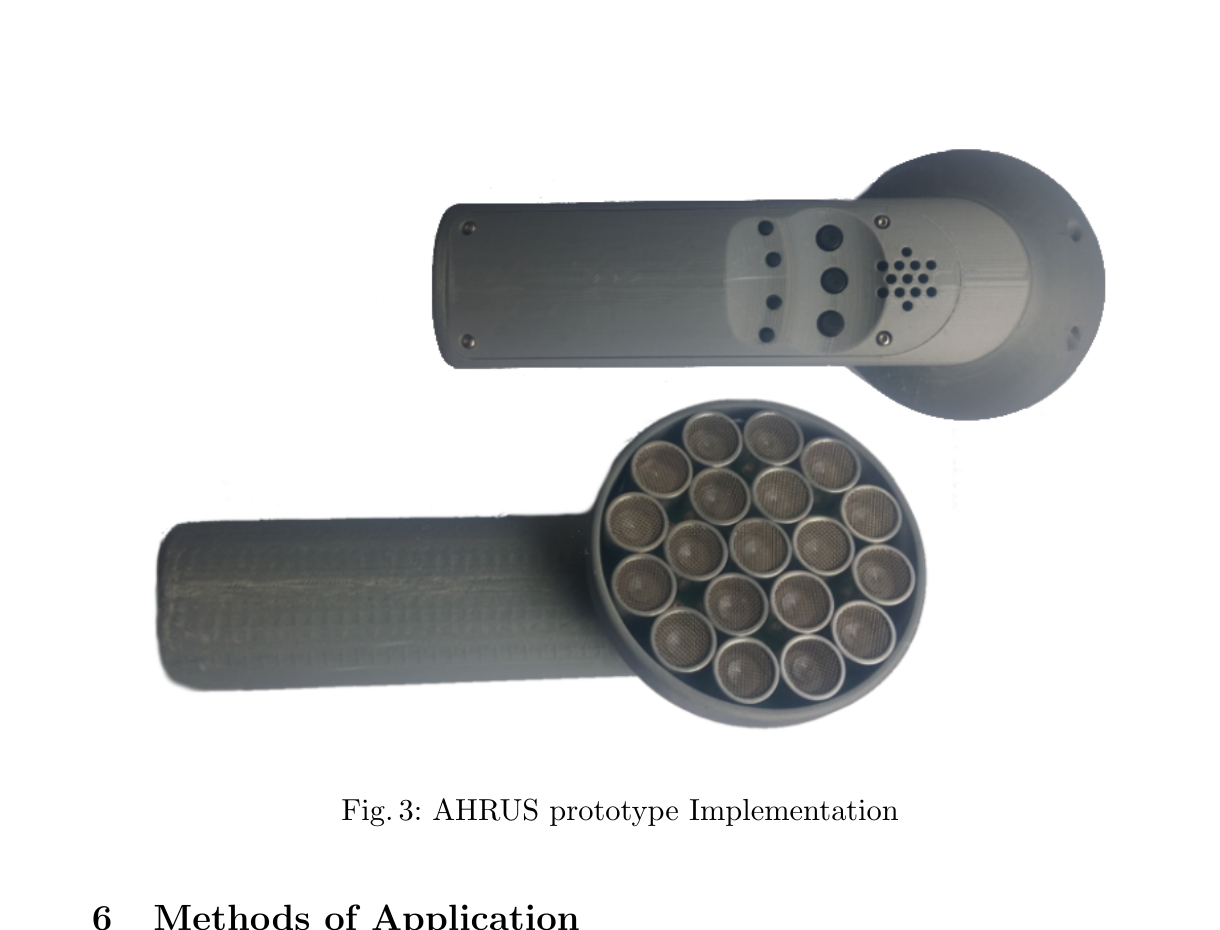

Fig. 3 Implementacion de prototipo. -

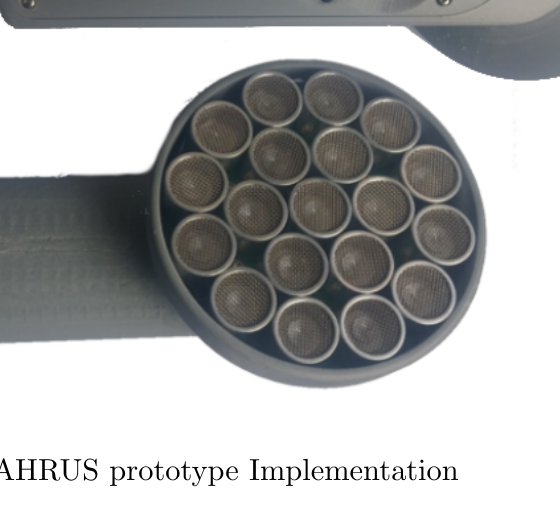

Fig. 3 Detalle de matriz de transductores. -

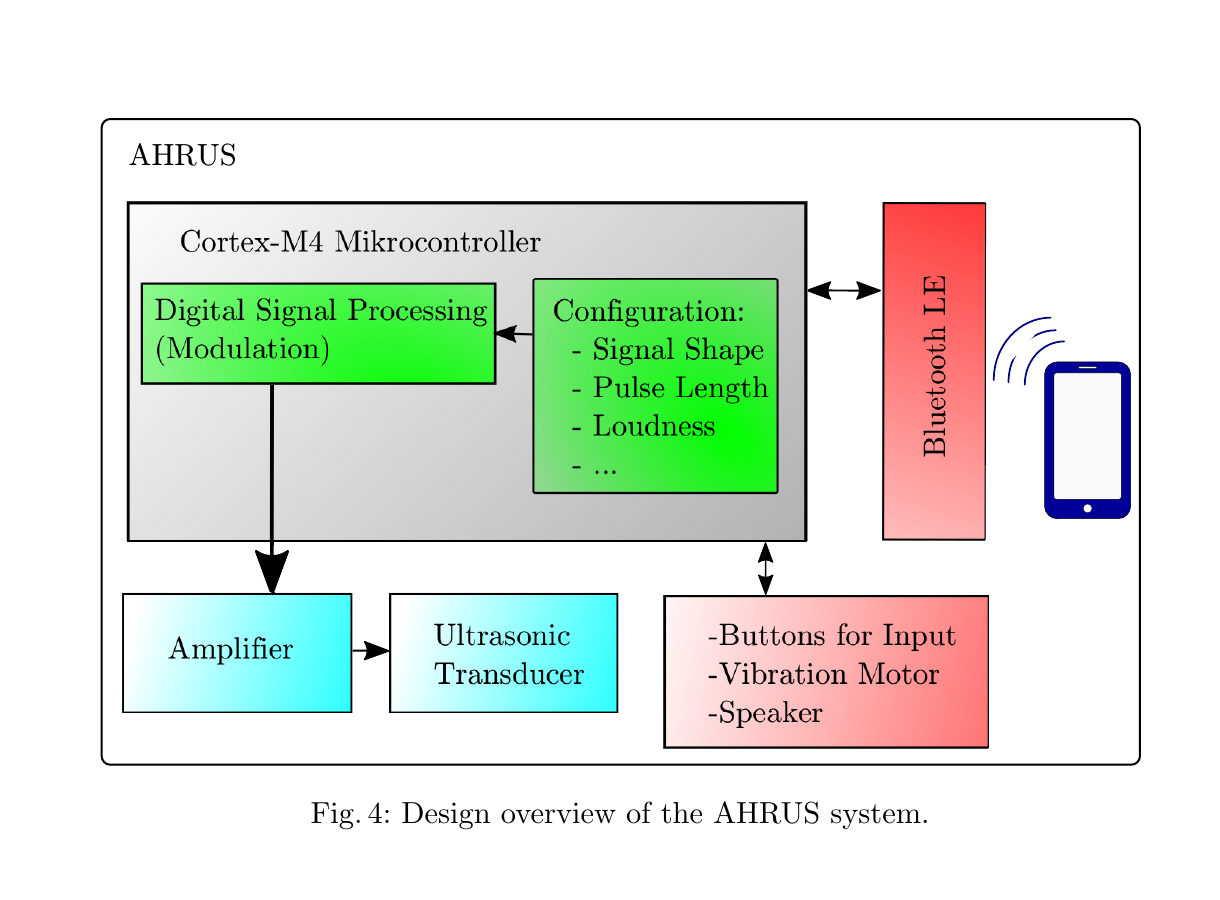

Fig. 4 Vista general del diseno del sistema AHRUS. -

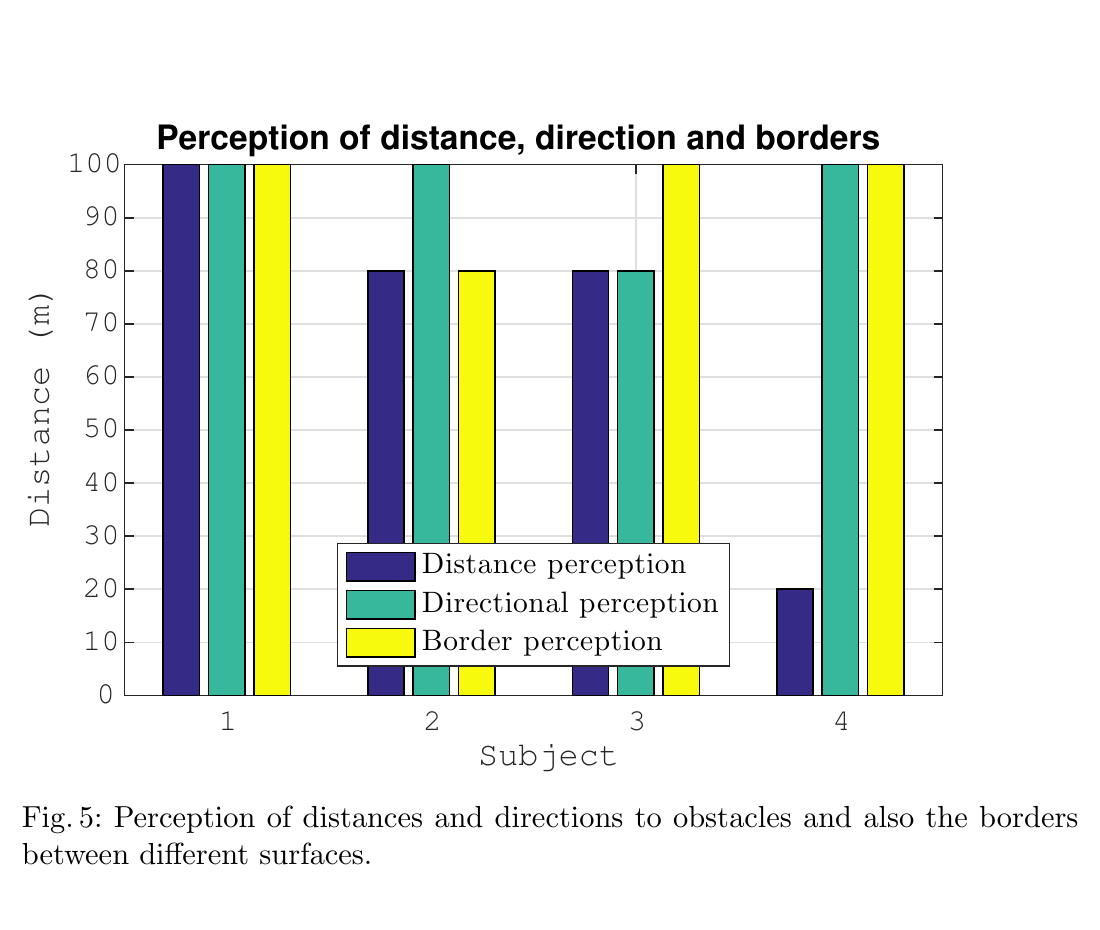

Fig. 5 Resultados sobre percepcion de distancia, direccion y limites. -

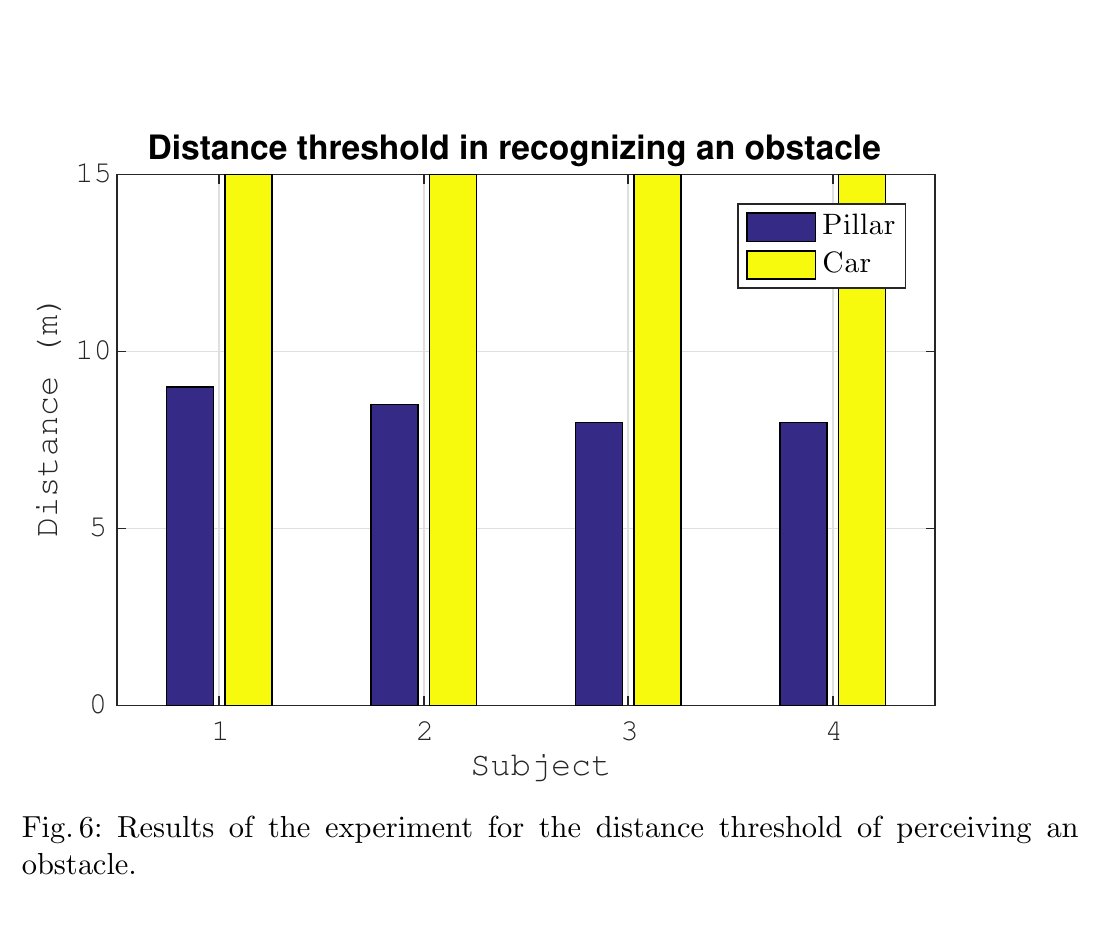

Fig. 6 Umbral de distancia en deteccion de obstaculos. -

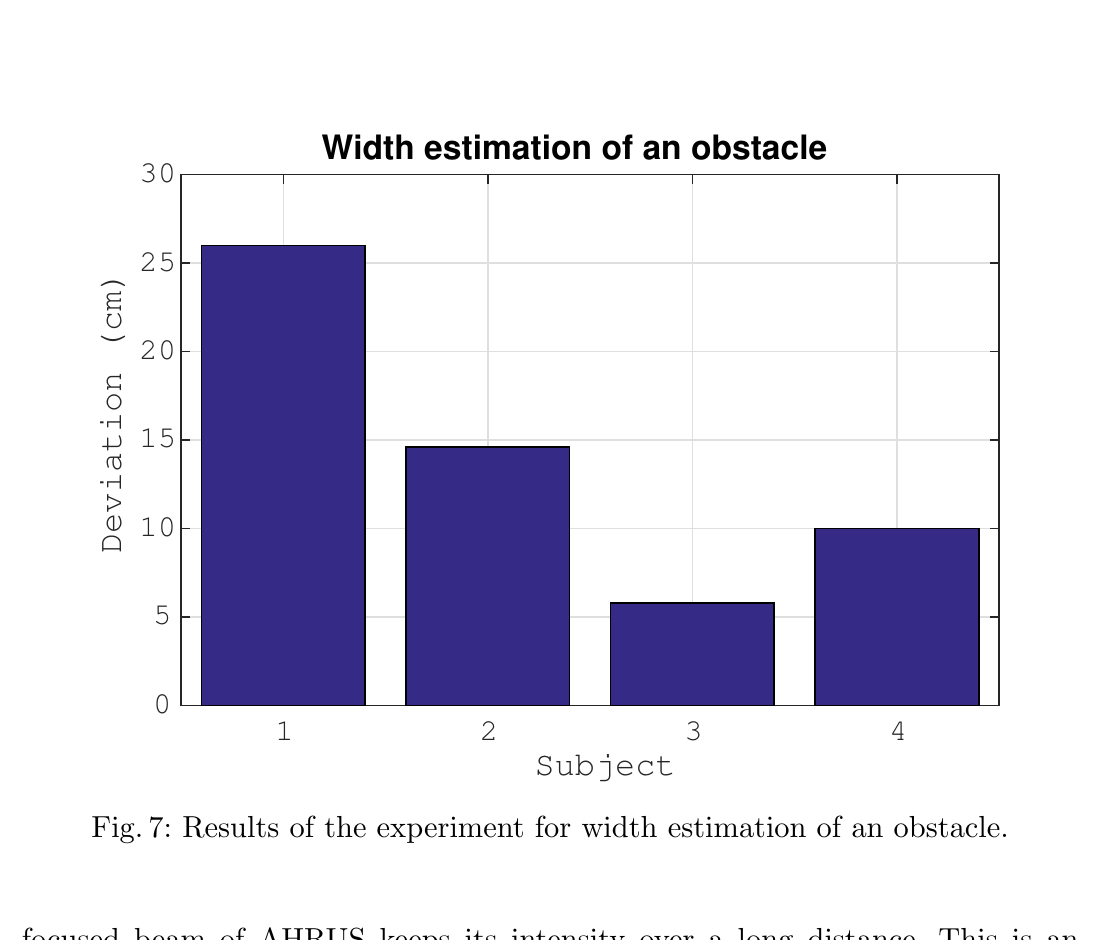

Fig. 7 Estimacion de anchura de obstaculo. -

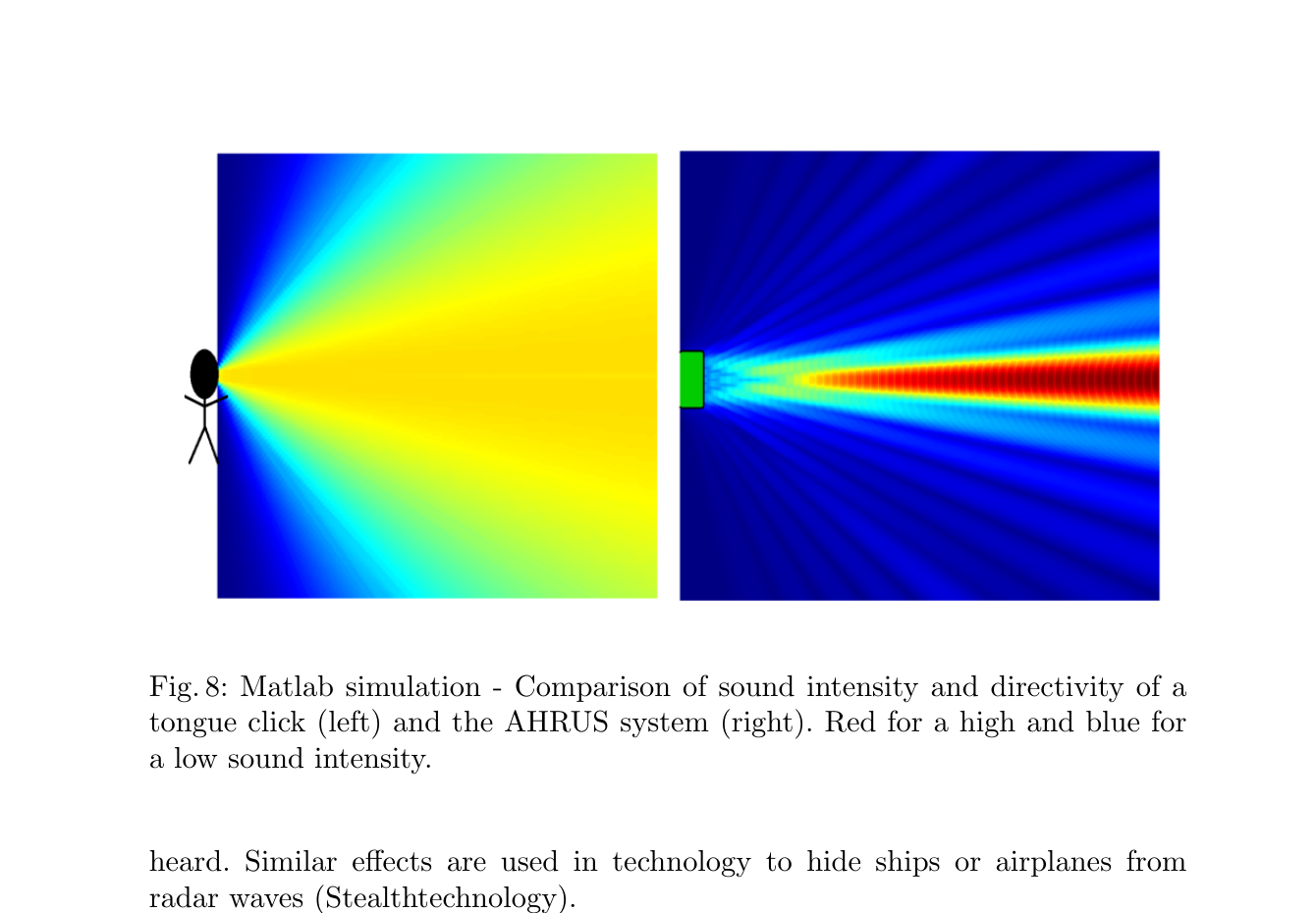

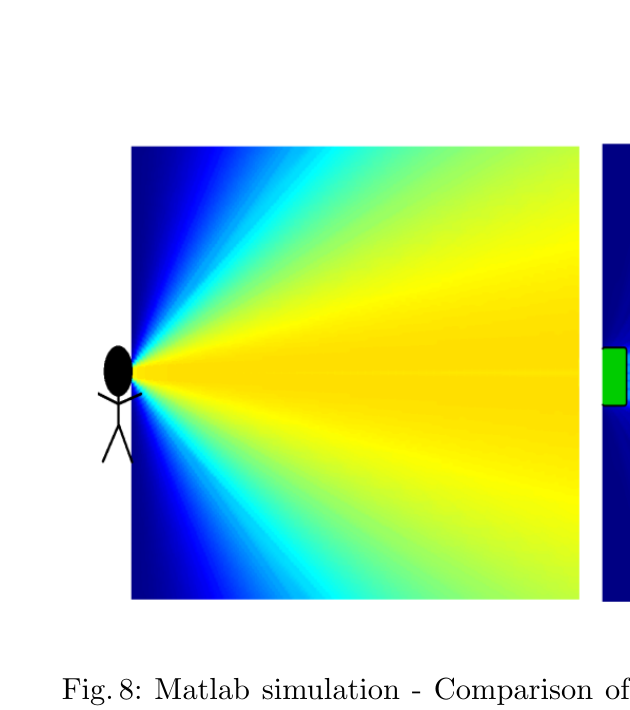

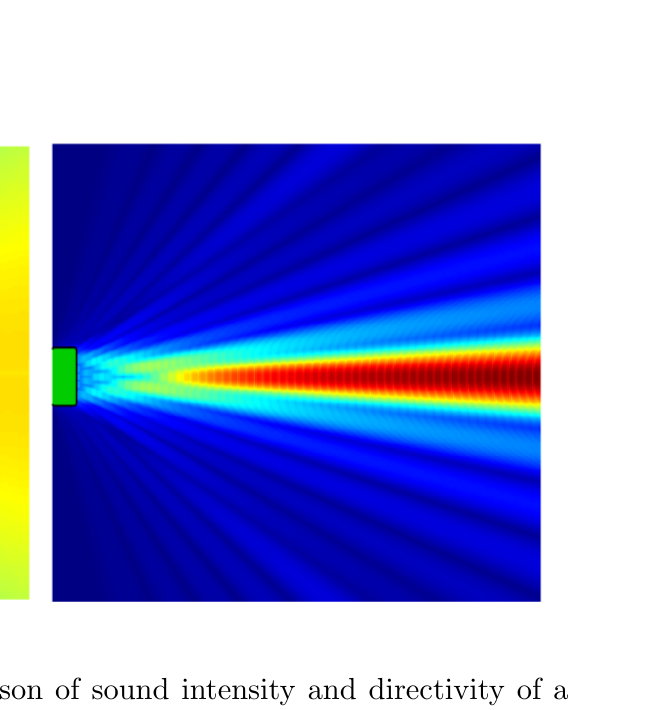

Fig. 8 Comparacion global de directividad. -

Fig. 8 Detalle izquierdo (flash sonar). -

Fig. 8 Detalle derecho (AHRUS).

BibTeX

@inproceedings{vonzabiensky2018ahrus,

title = {Ultrasonic Waves to Support Human Echolocation},

author = {von Zabiensky, Florian and Kreutzer, Michael and Bienhaus, Diethelm},

booktitle = {HCII},

year = {2018}

}

Notas adicionales

Lectura adicional: Ir al proyecto AHRUS