Owli-AI Forschungsprojekt

AHRUS Audible High Resolution Ultrasonic Sonar

AHRUS ist ein elektronisches Guide-Dog-Konzept, das Echolokation durch hoerbaren Ultraschall unterstuetzt. Das System soll Hindernisse und Strukturen fruehzeitiger wahrnehmbar machen, ohne die natuerliche Raumwahrnehmung durch Kopfhoerer zu ersetzen.

- echolocation

- ultrasound

- assistive technology

- spatial hearing

- obstacle detection

Projektbeschreibung

Ziel

Das Projekt AHRUS untersucht, wie Ultraschall als zusaetzlicher Orientierungskanal fuer blinde und sehbeeintraechtigte Menschen nutzbar wird. Ziel ist eine praxisnahe Unterstuetzung im Alltag, besonders bei kleinen Strukturen und schwer wahrnehmbaren Oberflaechen.

Wie es funktioniert (kurz)

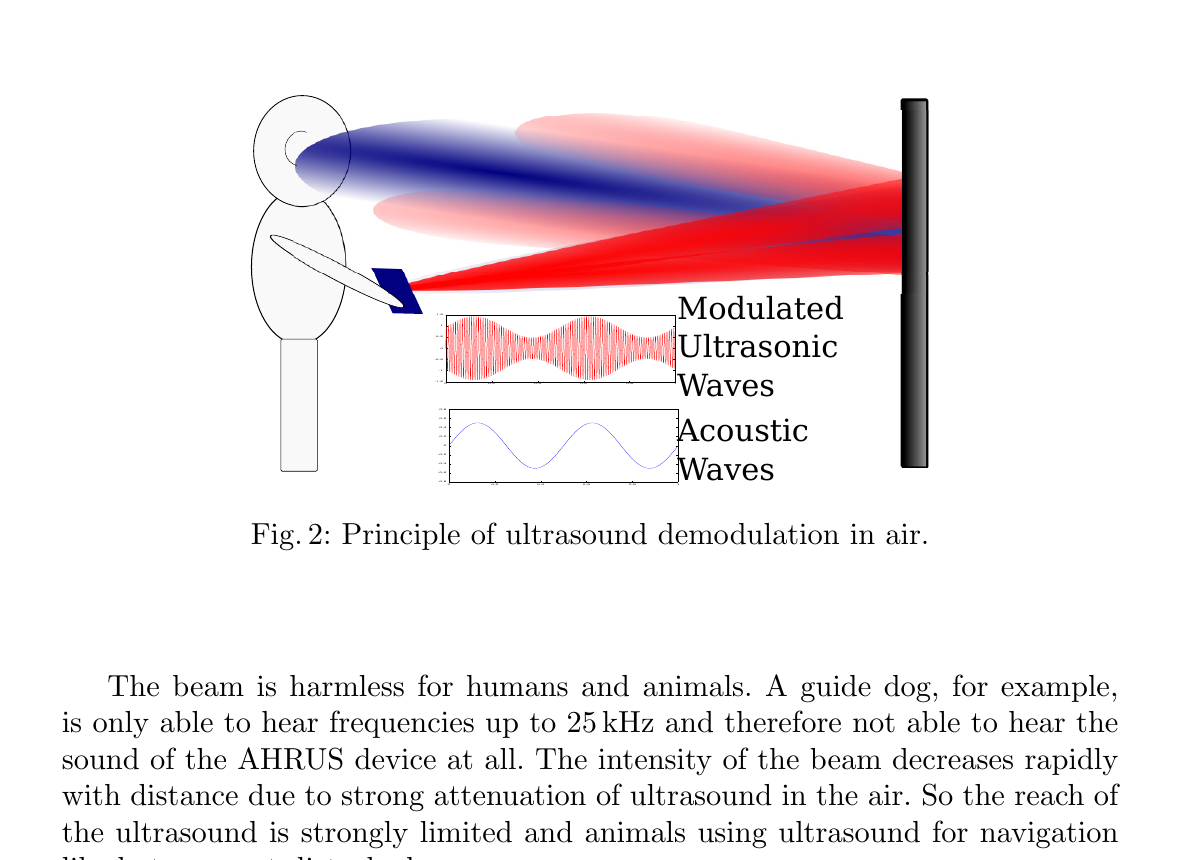

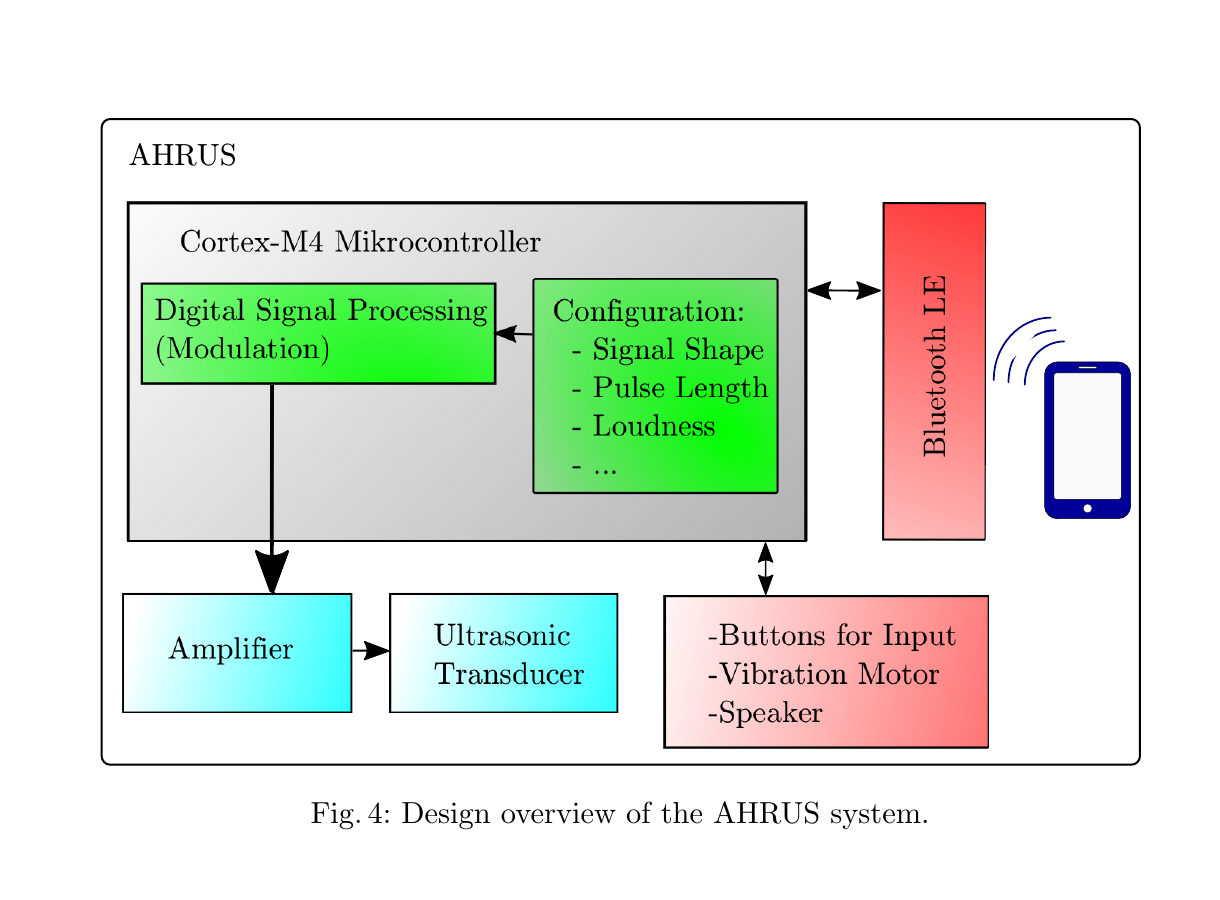

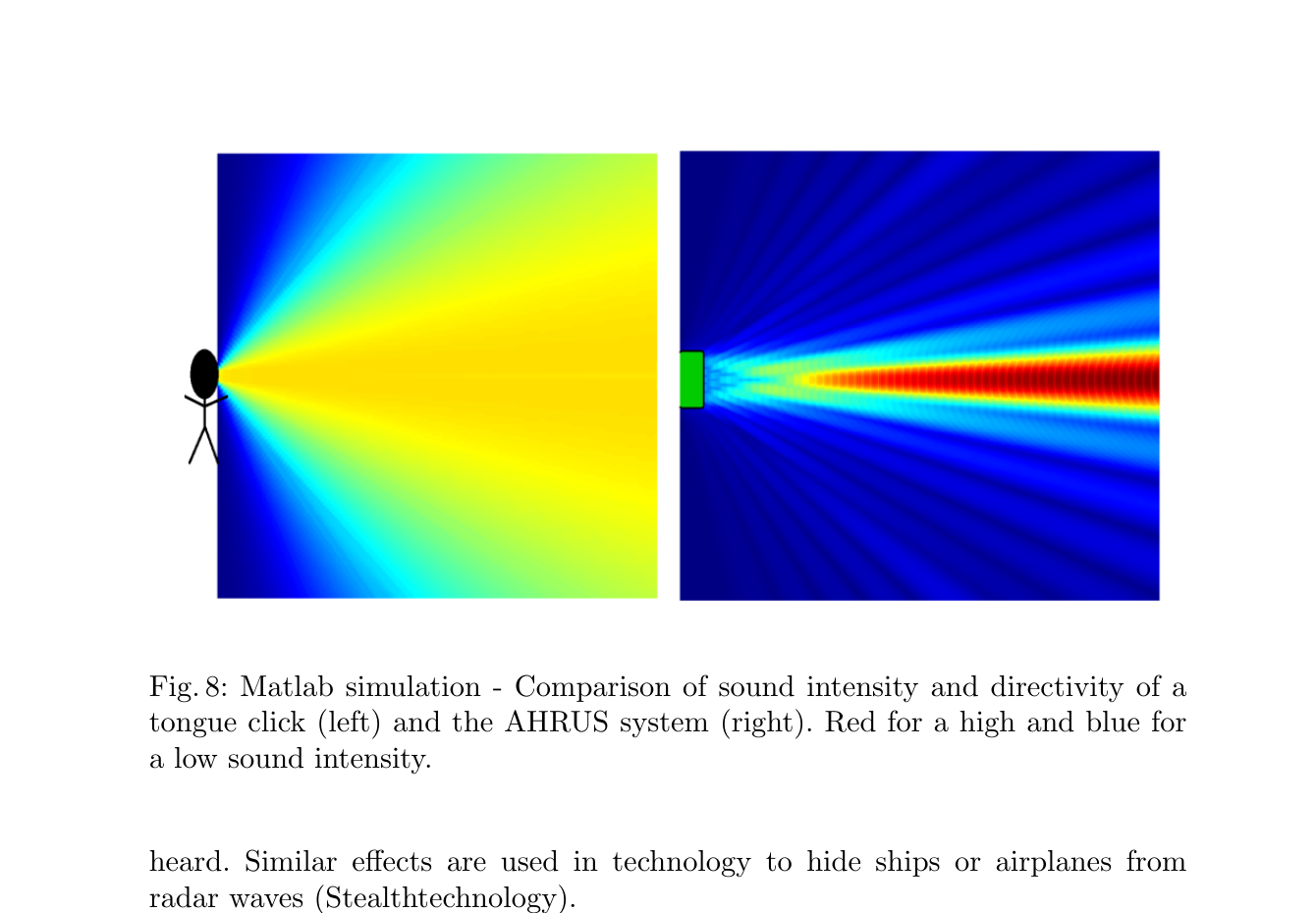

Ein fokussierter Ultraschallstrahl wird moduliert ausgesendet und durch nichtlineare Akustik in der Luft teilweise in hoerbare Signale ueberfuehrt. Reflektionen von Objekten koennen dadurch mit den eigenen Ohren wahrgenommen und raeumlich eingeordnet werden.

Was ist neu im Vergleich zu klassischer Echolokation?

Klassische aktive Echolokation mit Zungenklick arbeitet mit laengeren Wellenlaengen und ist dadurch weniger selektiv bei feinen Strukturen. AHRUS nutzt kurze Ultraschallwellen und ermoeglicht eine deutlich gerichtete Abtastung, wodurch Strukturgrenzen und kleine Hindernisse in bestimmten Szenarien besser differenzierbar werden.

Aktueller Stand (Prototyp & erste Tests)

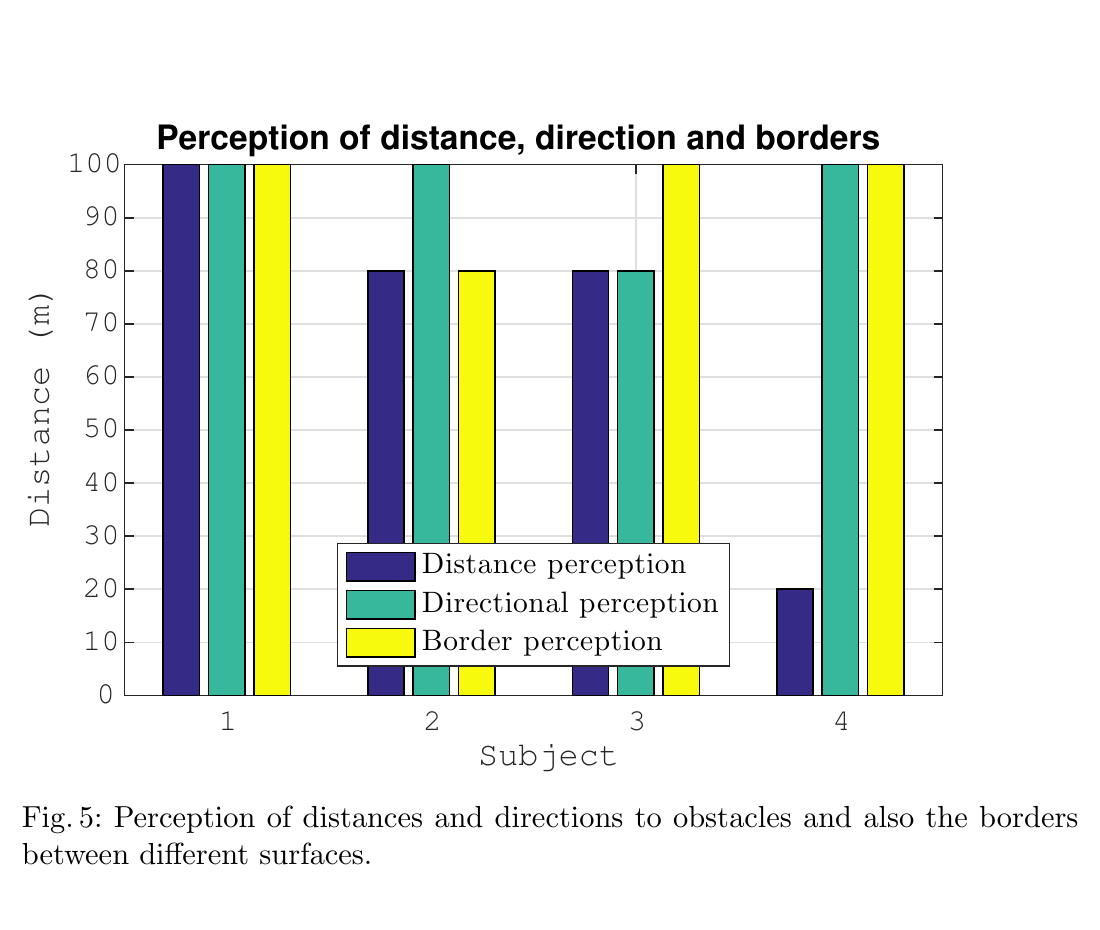

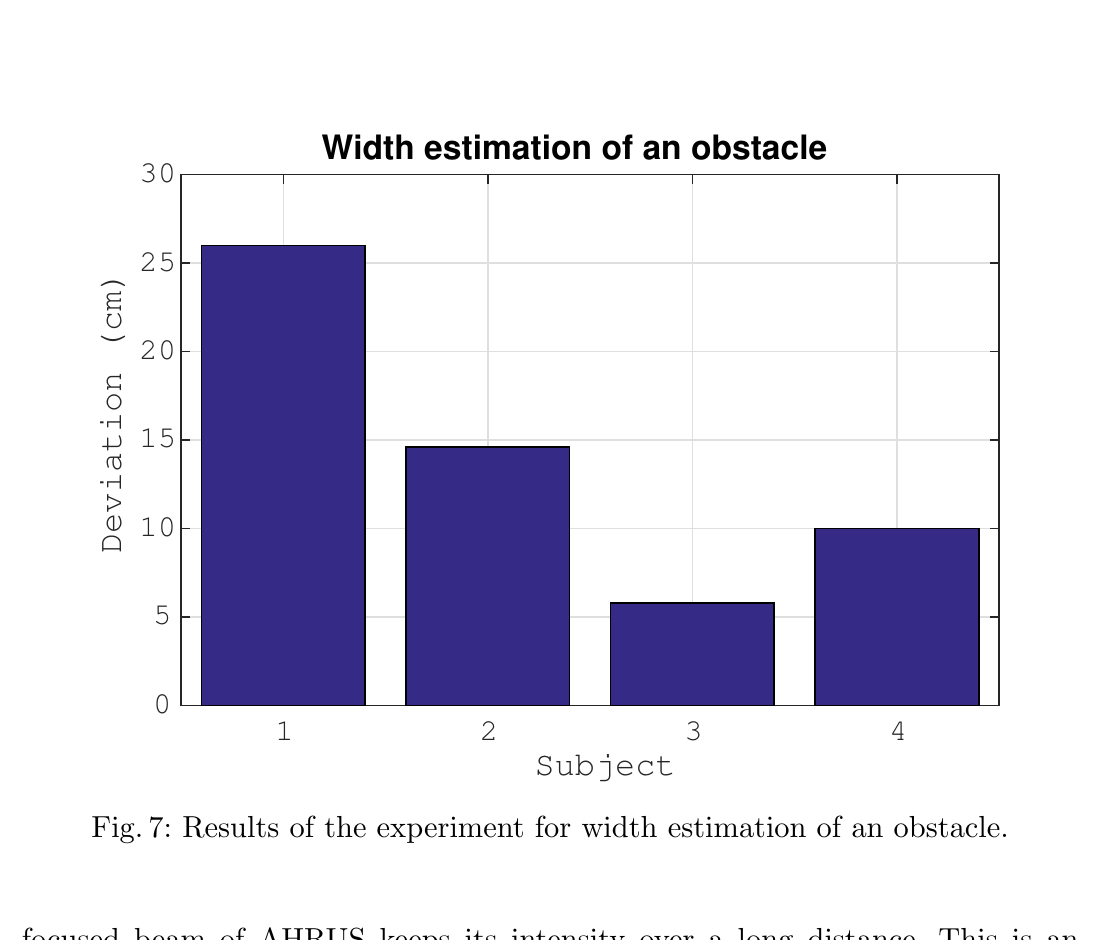

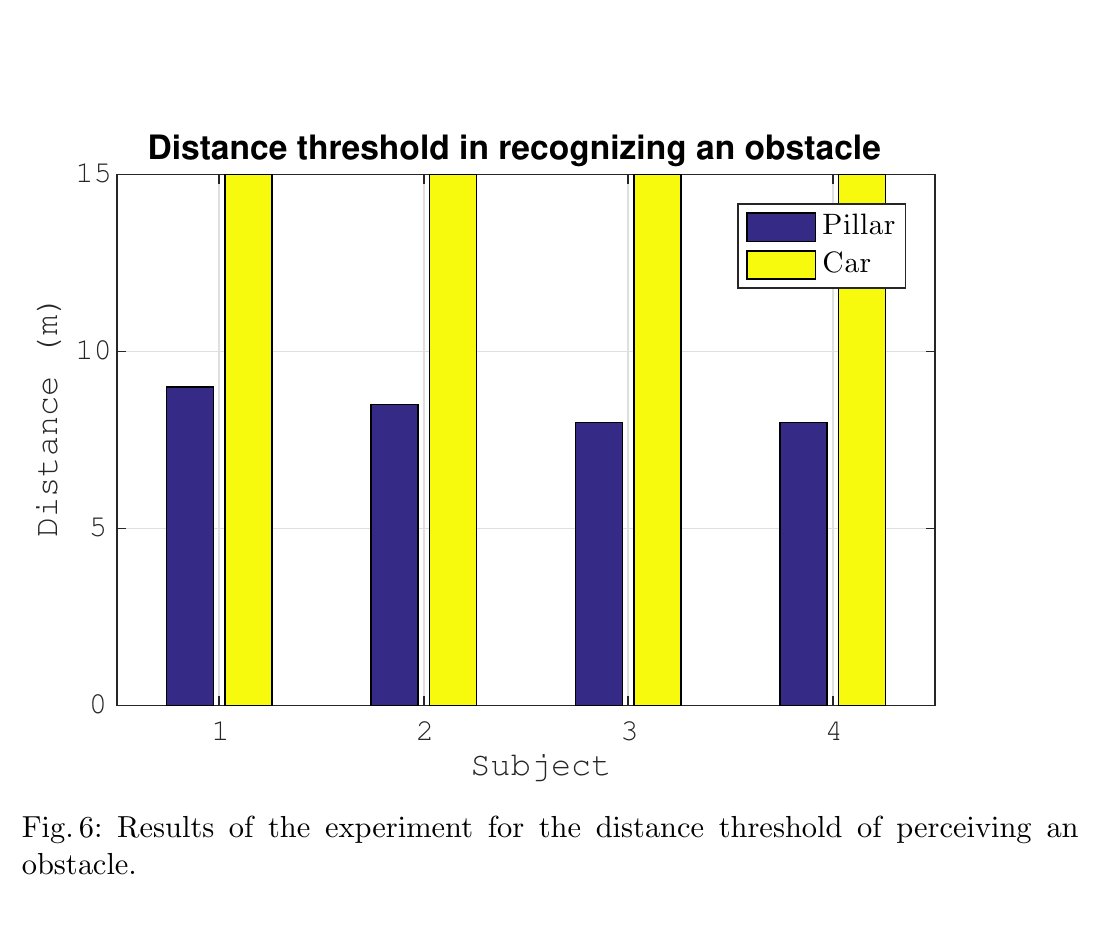

Es liegt ein funktionaler Prototyp vor. In einer ersten Evaluation mit vier Teilnehmenden wurden Distanz, Richtung, Breitenabschaetzung und Grenzwahrnehmung untersucht und mit klassischem Flash Sonar verglichen.

Outputs

- Publikation: Ultrasonic Waves to Support Human Echolocation

Abbildungen

13 Visuals aus dem AHRUS-Paper.

-

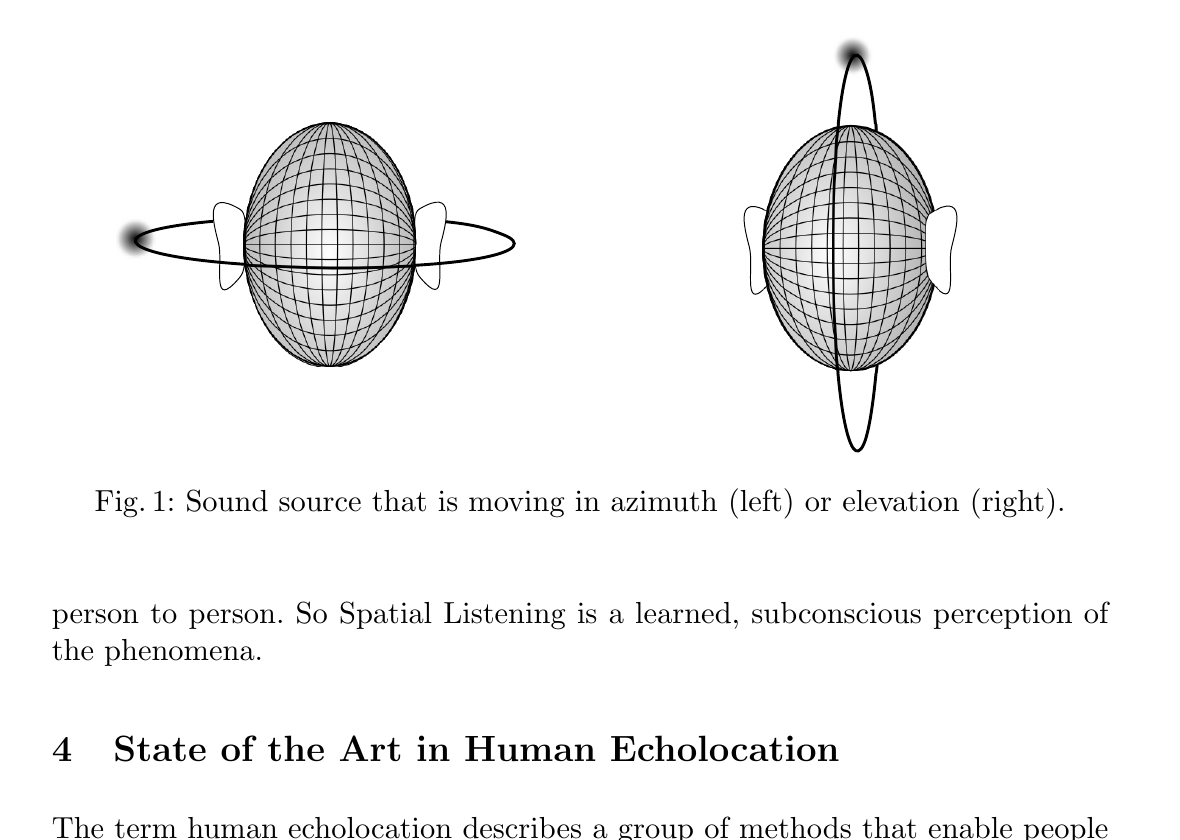

Fig. 1 Gesamtansicht der Richtungsdarstellung. -

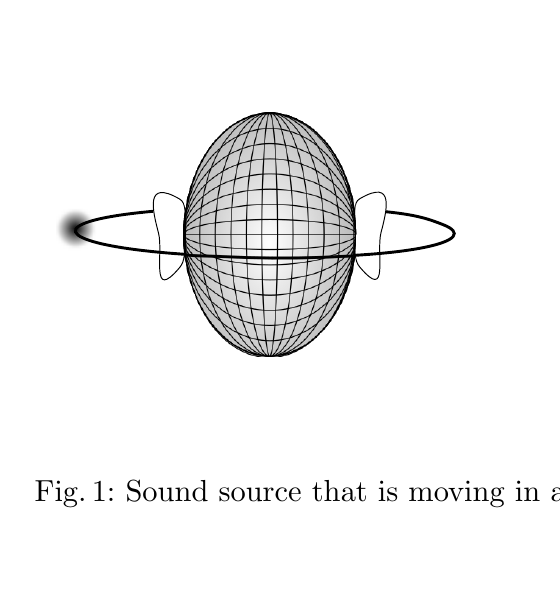

Fig. 1 Detail links (Azimut). -

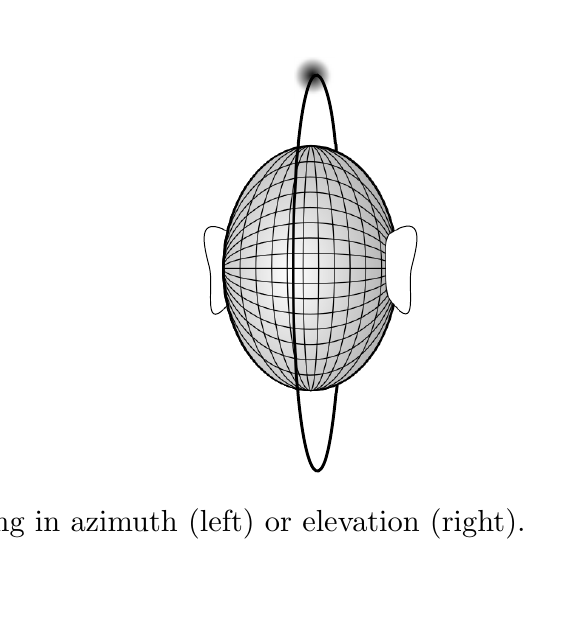

Fig. 1 Detail rechts (Elevation). -

Fig. 2 Prinzip der Ultraschall-Demodulation. -

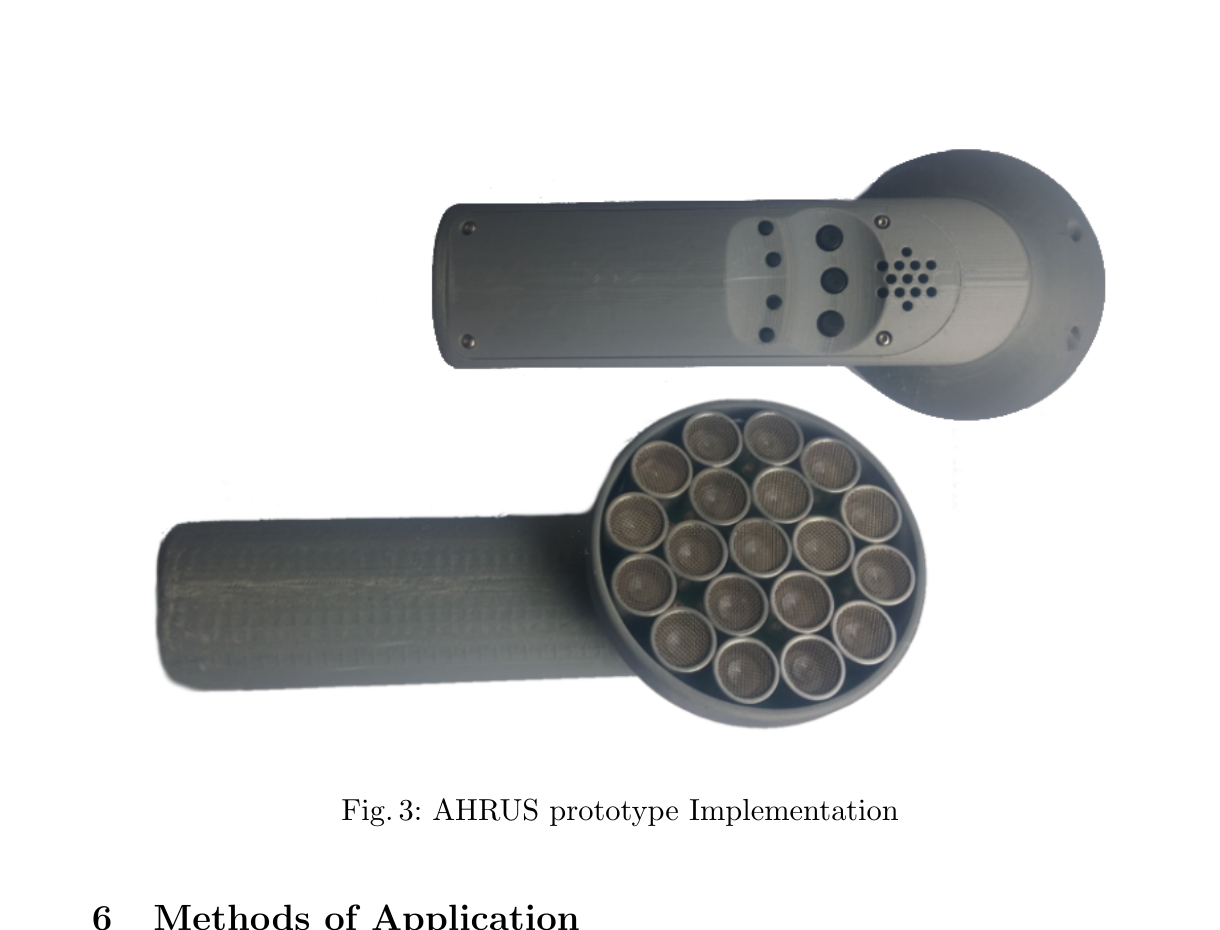

Fig. 3 Prototyp-Implementierung. -

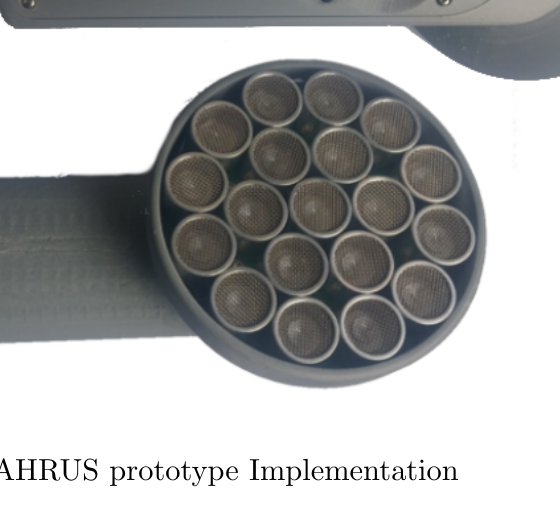

Fig. 3 Detail des Transducer-Arrays. -

Fig. 4 Design-Uebersicht des AHRUS-Systems. -

Fig. 5 Ergebnisse zu Distanz-, Richtungs- und Grenzwahrnehmung. -

Fig. 6 Distanzschwelle bei der Hinderniserkennung. -

Fig. 7 Breitenabschaetzung eines Hindernisses. -

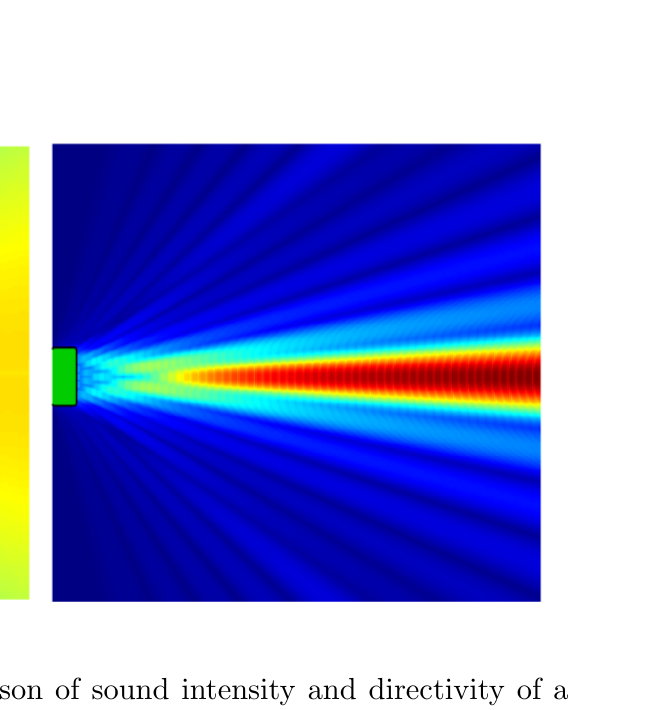

Fig. 8 Gesamtvergleich der Direktivitaet. -

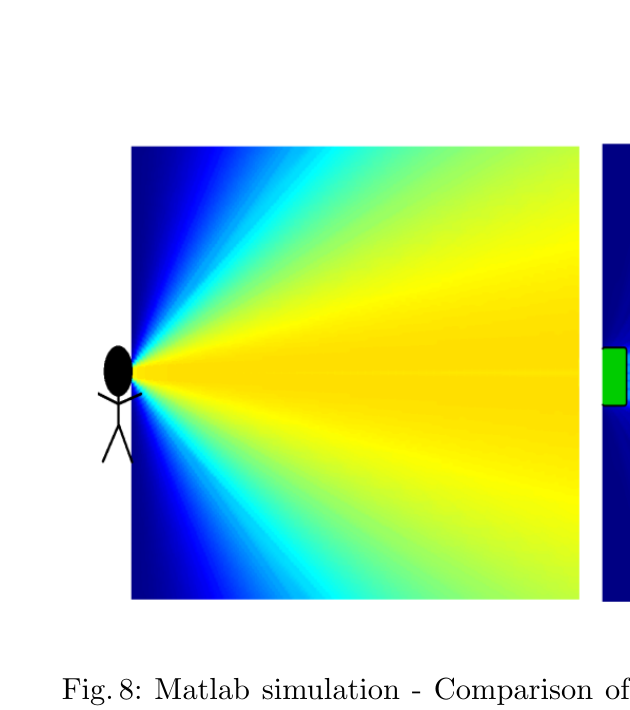

Fig. 8 Detail links (Flash Sonar). -

Fig. 8 Detail rechts (AHRUS).