Owli-AI Forschung

An Electronic Guide Dog for the Blind based on Artificial Neural Networks

(2021) - Paper

S. Lopatin; F. v. Zabiensky; M. Kreutzer; K. Rinn; D. Bienhaus

Technische Hochschule Mittelhessen, University of Applied Sciences, Institute of Technology and Computer Science, Giessen, Germany

Visual

Abstract

Das Paper praesentiert eine Machbarkeitsstudie fuer ein elektronisches Assistenzsystem, das blinde und sehbeeintraechtigte Menschen bei Orientierung und Navigation im oeffentlichen Raum unterstuetzen soll. Der Kernansatz ist die optische Erkennung von begehbaren Gehwegflaechen mit semantischer Segmentierung durch ein von Grund auf trainiertes neuronales Netz. In der praktischen Umsetzung wird ein NVIDIA Jetson Nano als mobile Recheneinheit fuer On-Device-Inferenz eingesetzt. Aus der erkannten Gehwegstruktur werden Navigationshinweise abgeleitet, die als Sprachausgabe an die nutzende Person ausgegeben werden. Damit untersucht die Arbeit die technische Umsetzbarkeit eines tragbaren Electronic Guide Dog auf Basis von Computer Vision und CNN.

Keywords

- electronic travel aid

- blind sidewalk detection

- portable ETA system

- electronic travel aid technology

- computer vision

- convolutional neural network

Download

Abbildungen

7 Visuals aus dem Paper.

-

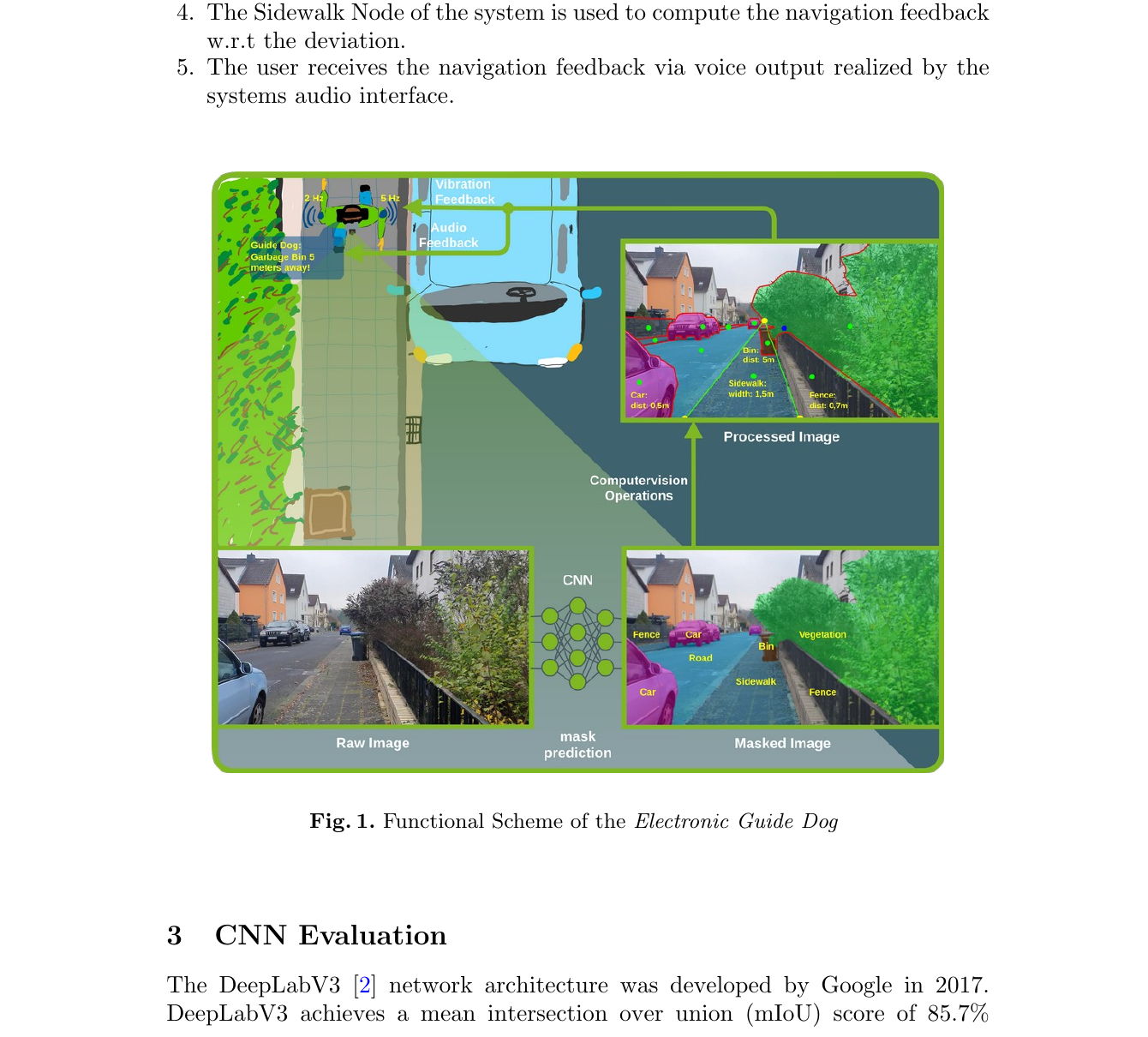

Fig. 1 Funktionales Schema des Electronic Guide Dog. -

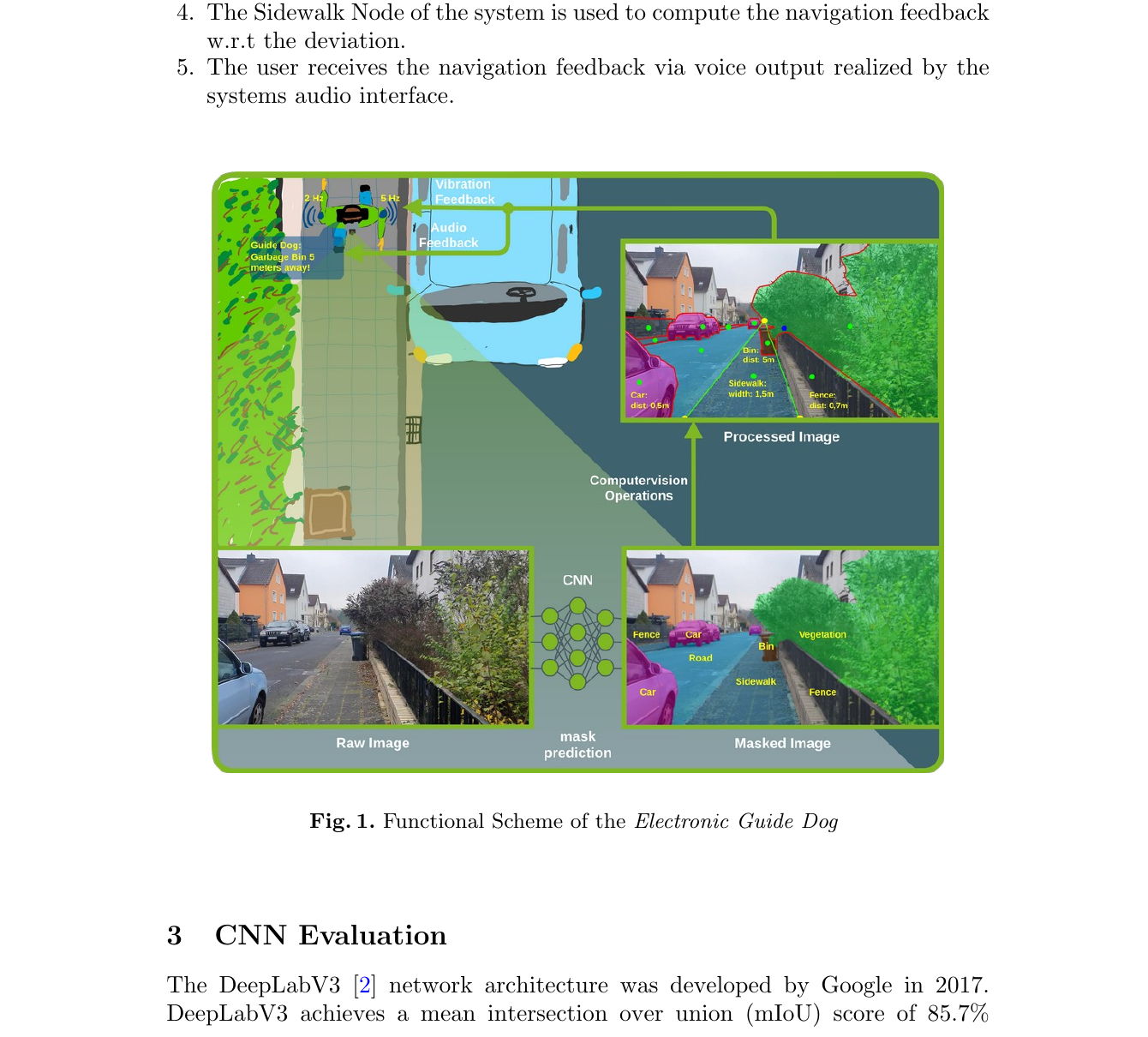

Fig. 2 Systemarchitektur mit datenflussbasierter Verarbeitung. -

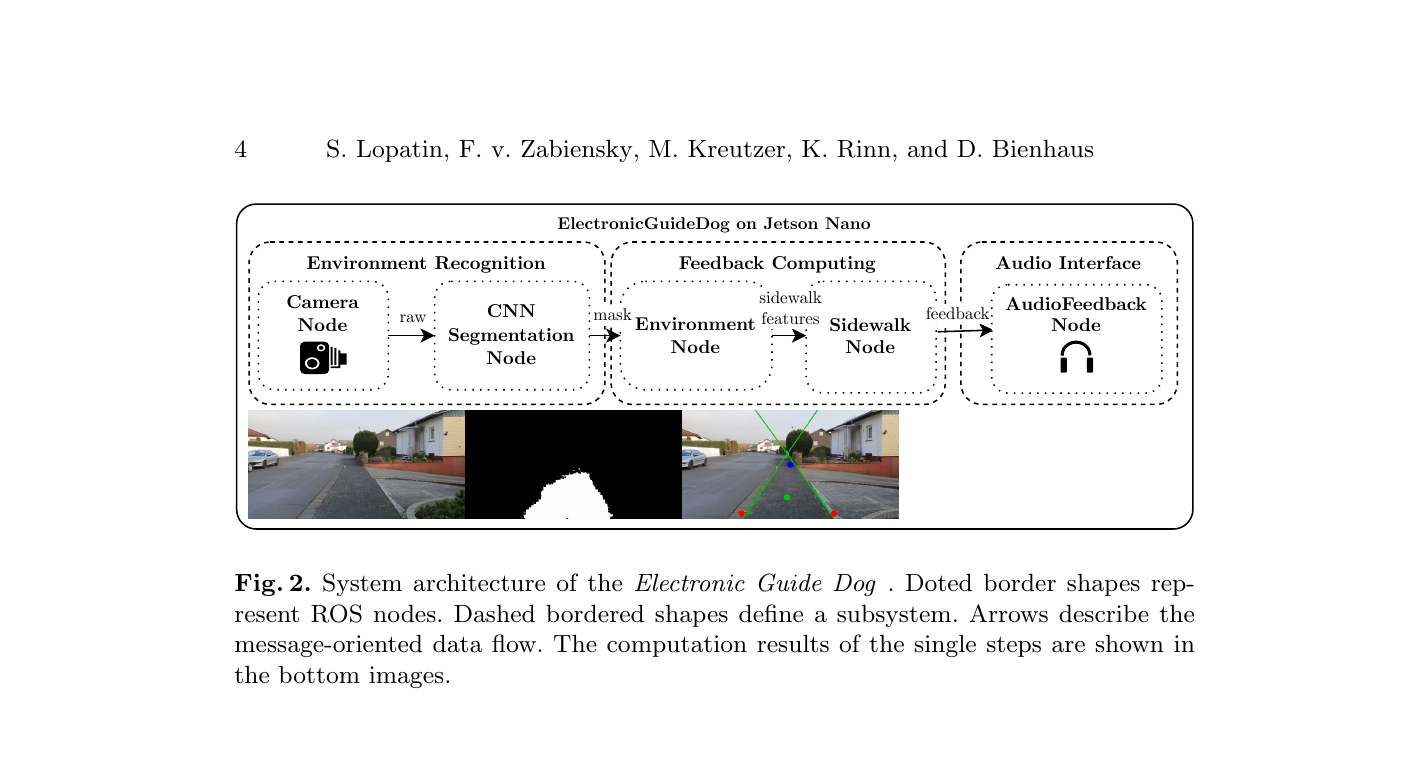

Fig. 3 Vergleich von Geschwindigkeit und Praezision. -

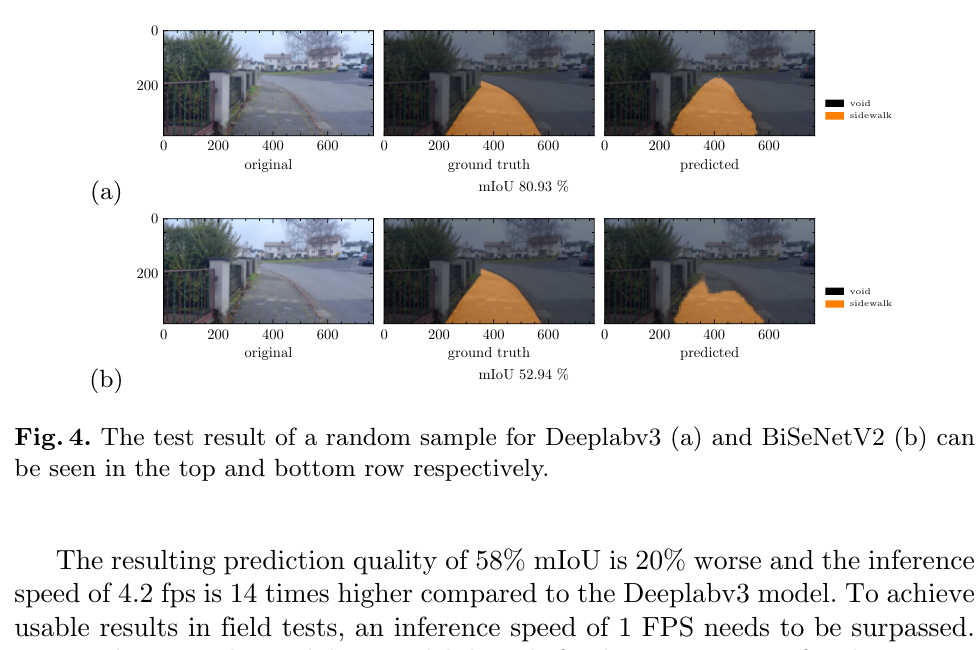

Fig. 4 Vergleichsergebnis eines Testsamples fuer DeepLabV3 und BiSeNetV2. -

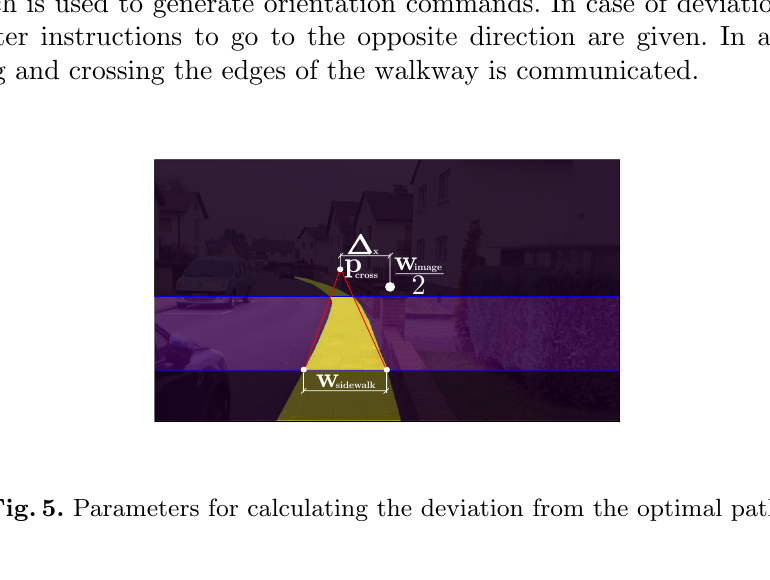

Fig. 5 Parameter zur Abweichungsberechnung vom optimalen Pfad. -

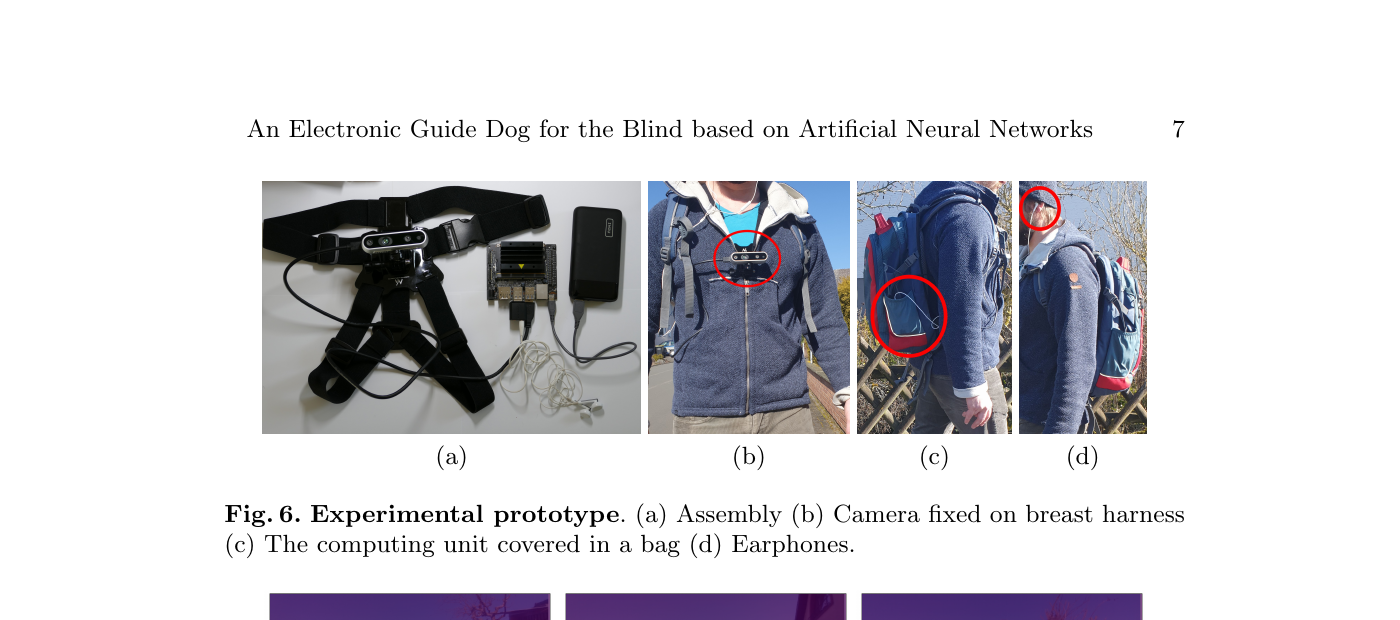

Fig. 6 Experimenteller Prototyp im Feldtest-Setup. -

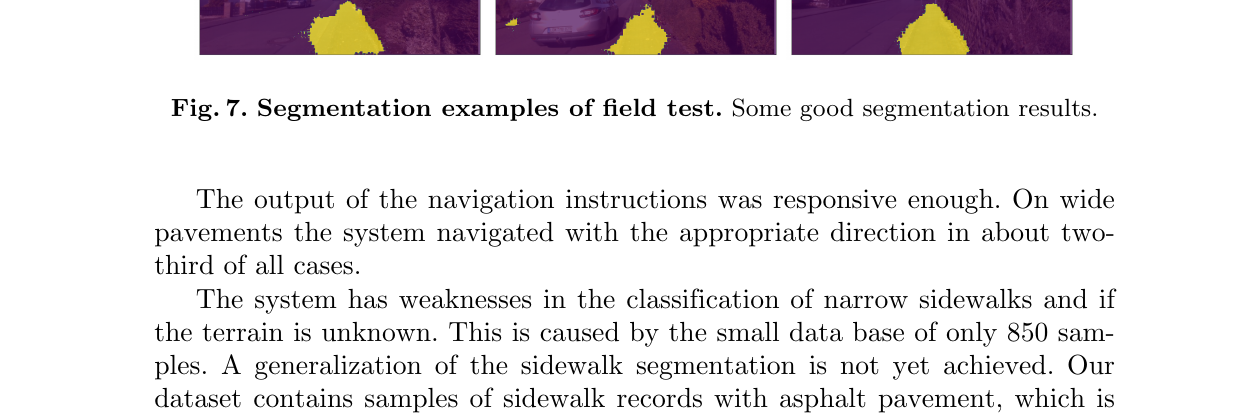

Fig. 7 Segmentierungsbeispiele aus dem Feldtest.